Künstliche Intelligenz, Ethik, Menschenrechte – und Tapas: Ein Rückblick auf die EELISA Summer School in Madrid

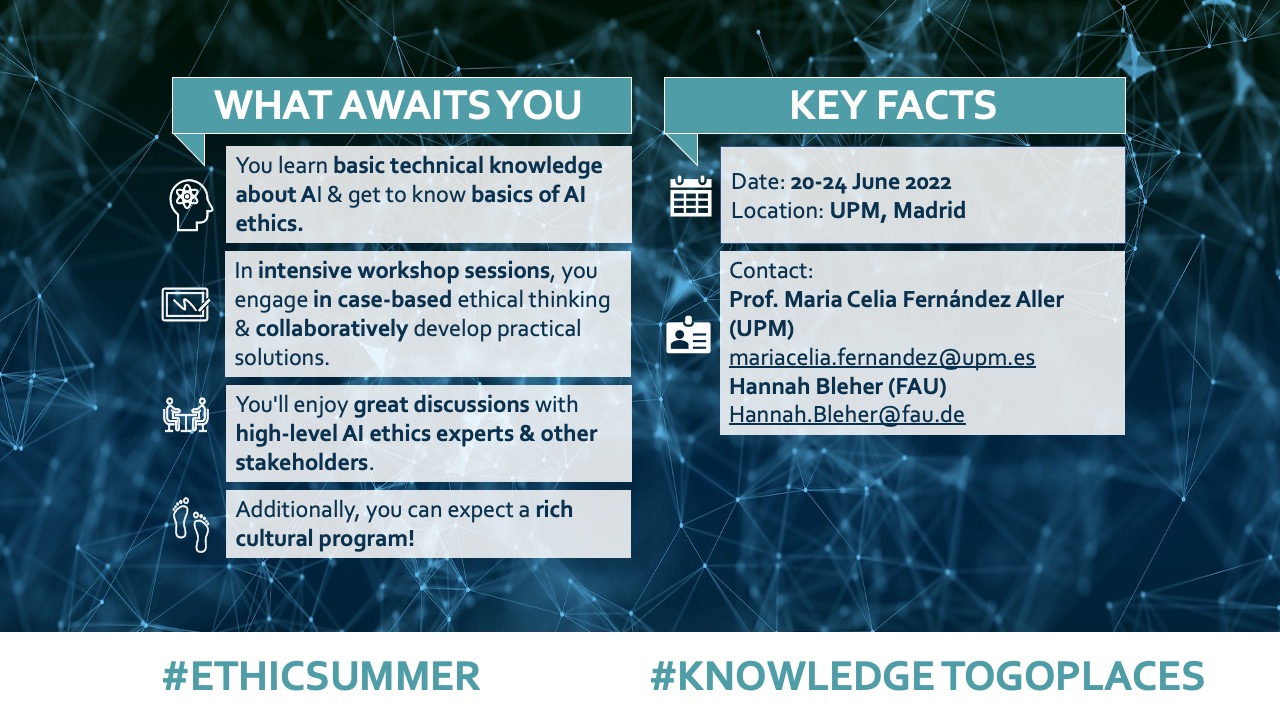

Künstliche Intelligenz, Ethik und Menschenrechte – ein Schlagworttrio, das auf den ersten Blick erst einmal nicht so viel miteinander zu tun zu haben scheint. Als ich zum ersten Mal von der Summer School hörte, war ich deshalb überrascht, dass hier zwei so gegensätzliche Thematiken zusammenkommen. Auf der einen Seite Ethik und Menschenrechte als Schwerpunkte gesellschaftspolitischer Wissenschaften und auf der anderen Seite künstliche Intelligenz als technische Größe. Ich muss aber auch zugeben, dass ich mich vorher kaum mit künstlicher Intelligenz auseinandergesetzt hatte, also war es vielleicht nicht weiter überraschend, dass ich keine offensichtliche Verbindung gesehen habe. „Aber warum nicht“, dachte ich, „man muss ja auch mal was Neues ausprobieren.“ Und so ging es für mich und 11 weitere Studierende am 20.06. für eine Woche nach Madrid, um bei einer Summer School mehr über eben diese drei Themen und ihre Relation zu erfahren. Als hierfür der Wecker nachts um halb vier klingelte, kam ich zwar noch einmal ins Zweifeln, ob etwas Neues wirklich immer sein muss, aber nachdem die erste Müdigkeit dann überwunden war, wuchs die Vorfreude.

Künstliche Intelligenz, Ethik und Menschenrechte – ein Schlagworttrio, das auf den ersten Blick erst einmal nicht so viel miteinander zu tun zu haben scheint. Als ich zum ersten Mal von der Summer School hörte, war ich deshalb überrascht, dass hier zwei so gegensätzliche Thematiken zusammenkommen. Auf der einen Seite Ethik und Menschenrechte als Schwerpunkte gesellschaftspolitischer Wissenschaften und auf der anderen Seite künstliche Intelligenz als technische Größe. Ich muss aber auch zugeben, dass ich mich vorher kaum mit künstlicher Intelligenz auseinandergesetzt hatte, also war es vielleicht nicht weiter überraschend, dass ich keine offensichtliche Verbindung gesehen habe. „Aber warum nicht“, dachte ich, „man muss ja auch mal was Neues ausprobieren.“ Und so ging es für mich und 11 weitere Studierende am 20.06. für eine Woche nach Madrid, um bei einer Summer School mehr über eben diese drei Themen und ihre Relation zu erfahren. Als hierfür der Wecker nachts um halb vier klingelte, kam ich zwar noch einmal ins Zweifeln, ob etwas Neues wirklich immer sein muss, aber nachdem die erste Müdigkeit dann überwunden war, wuchs die Vorfreude.

Aber zurück zu den drei themengebenden Titelwörtern. Was bedeuten diese denn eigentlich? Menschenrechte – gut, die kennt wohl jeder. Sie umfassen einen Katalog an Rechten, die jeder Mensch aufgrund seines Mensch-Seins innehat. Ethik kann knapp als die Reflexion über die Moral definiert werden – so weit so eingängig. Aber was ist künstliche Intelligenz? Gehört habe ich davon schon, doch was verbirgt sich dahinter? Ich kenne Siri, Alexa und Cortana. Ich weiß, dass Netflix mir Empfehlungen basierend auf meinen bisherigen Präferenzen schickt. Und ich habe alle Iron Man-Filme geschaut und Tony Starks selbstgebaute künstliche Intelligenz Jarvis vom Computer bis zum Menschen wachsen sehen. Eine richtige Antwort auf die Frage ist das allerdings nicht. Die gibt dafür die Informatikerin Elaine Rich: Sie sagt, künstliche Intelligenz sei die Forschung daran, wie zukünftig Computer Dinge tun können, in denen bisher Menschen noch besser sind.[1] Auf lange Sicht soll also der Computer die Arbeit der Menschen übernehmen und ersetzen. Künstliche Intelligenz wird hierfür im logischen Denken, in der Problemlösung und der Sammlung von Wissen durch Daten trainiert.

Bei der Frage wie Ethik, Menschenrechte und künstliche Intelligenz nun zusammenpassen, gibt es eine erste, einfache Antwort: Sie alle sind von größter gesellschaftlicher Relevanz. Aber das ist nicht alles, was sie verbindet. Bereits am ersten Abend in Madrid wurde uns Teilnehmenden die enge, vielschichtige Vernetzung dieser drei Disziplinen bewusst gemacht. Im Rahmen eines Kennenlernabends sollten wir in Kleingruppen drei einfache Fragen beantworten: Welche Art von künstlicher Intelligenz nutzen wir in unserem Alltag am häufigsten, welche Vorteile bietet künstliche Intelligenz und welche Nachteile und Gefahren? Und schon waren wir mittendrin in der Komplexität des Themas. Denn künstliche Intelligenz findet sich quasi überall, angefangen bei Algorithmen auf Social Media, bis hin zu ihrem Einsatz in der modernen Medizin. Und plötzlich erschien es mir nur logisch, künstliche Intelligenz in Verbindung zu Ethik und Menschenrechten zu betrachten. Denn so angenehm es auch ist, dass mir Inhalte auf Amazon, Instagram und Co. bereits vorsortiert werden oder wie entspannt es ist, sämtliche technischen Geräte in meiner Wohnung ganz einfach per App oder Sprachassistent zu steuern, künstliche Intelligenz ist vor allem auch eines: ein gigantischer Datensammler und anfällig für sogenannte Biases, also Vorurteile und daraus resultierenden Ungleichbehandlungen. Denn auch wenn der Name künstliche Intelligenz Unabhängigkeit und Selbstständigkeit suggeriert, KI ist trotzdem von Menschen geschaffen. Und deren Einstellungen, Meinungen und Weltsichten finden sich deshalb allzu häufig auch in ihren Systemen.

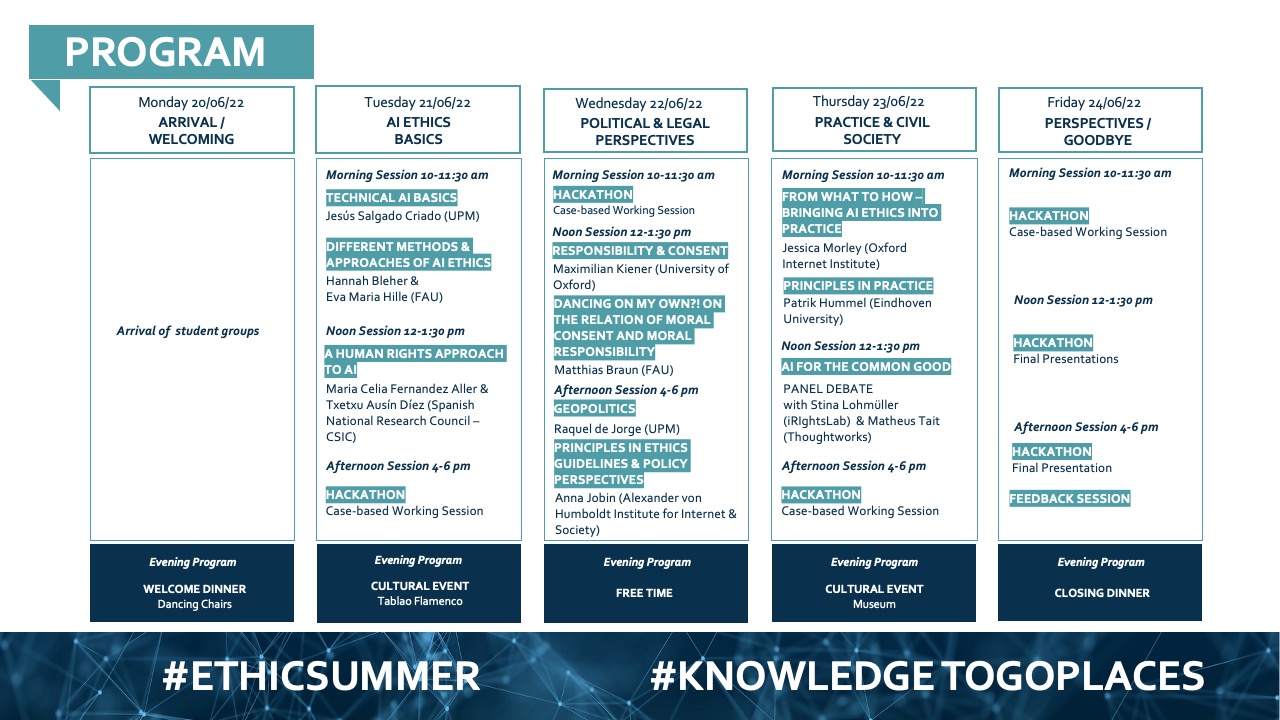

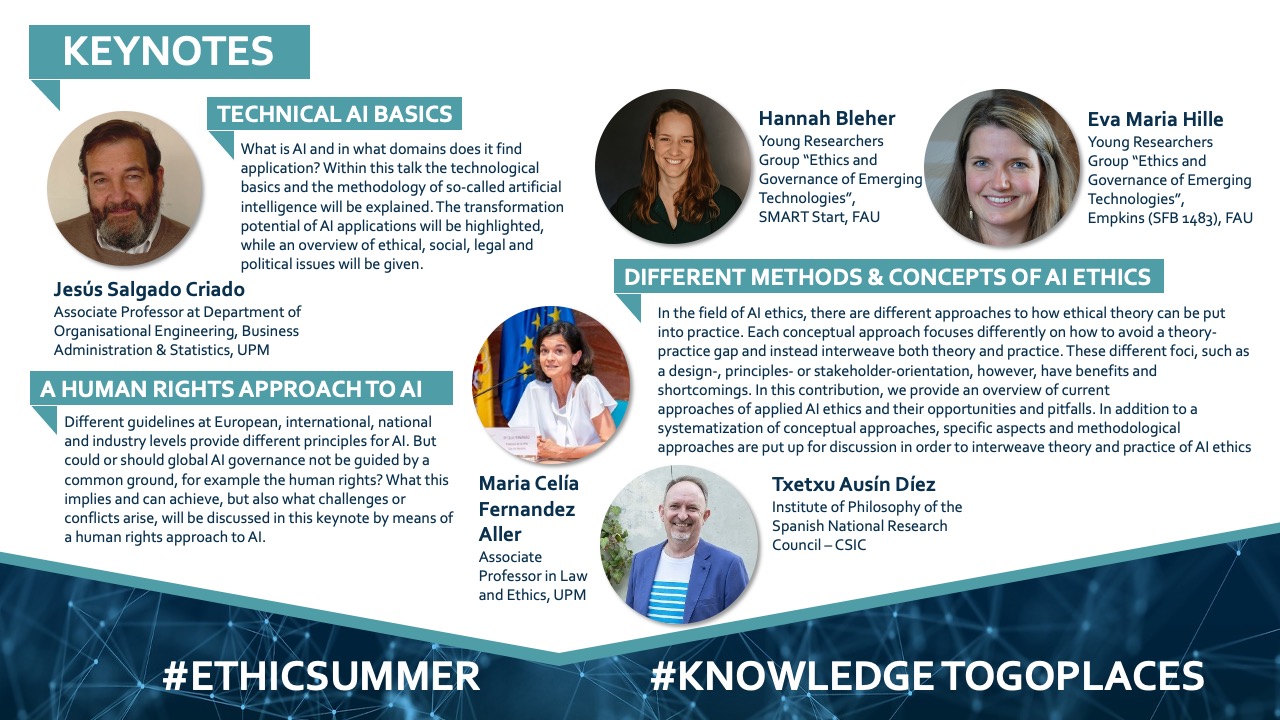

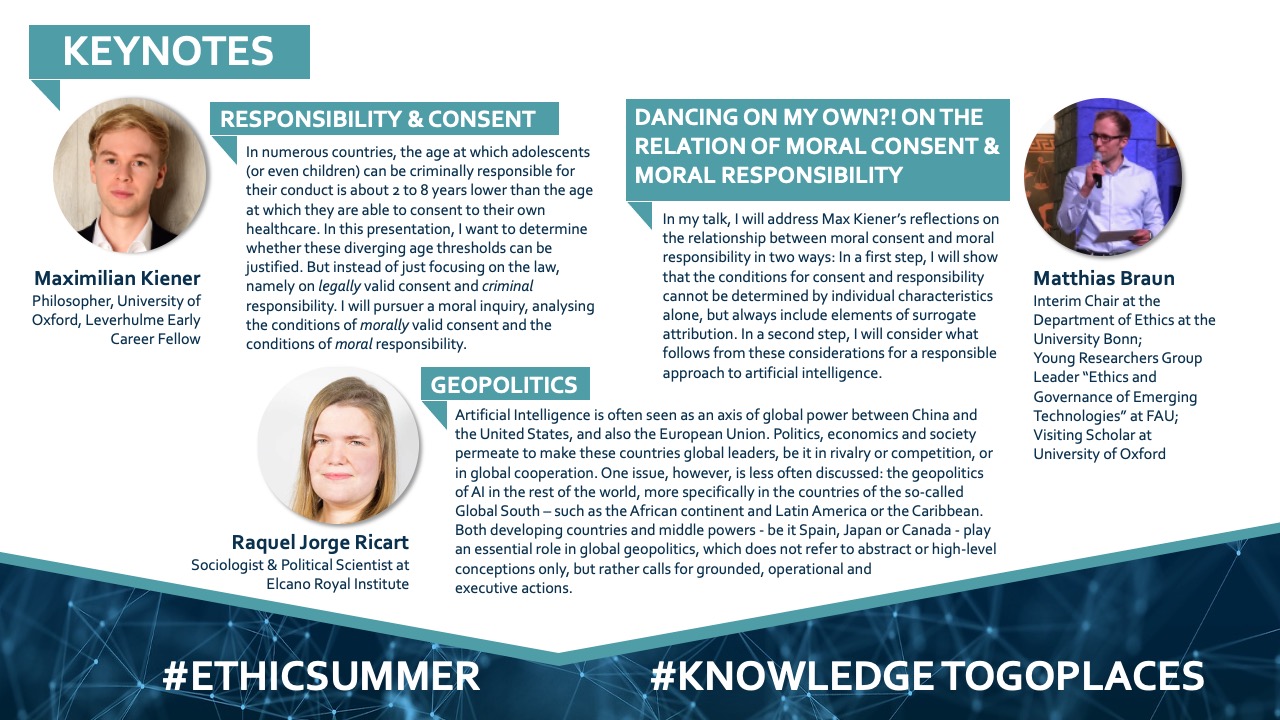

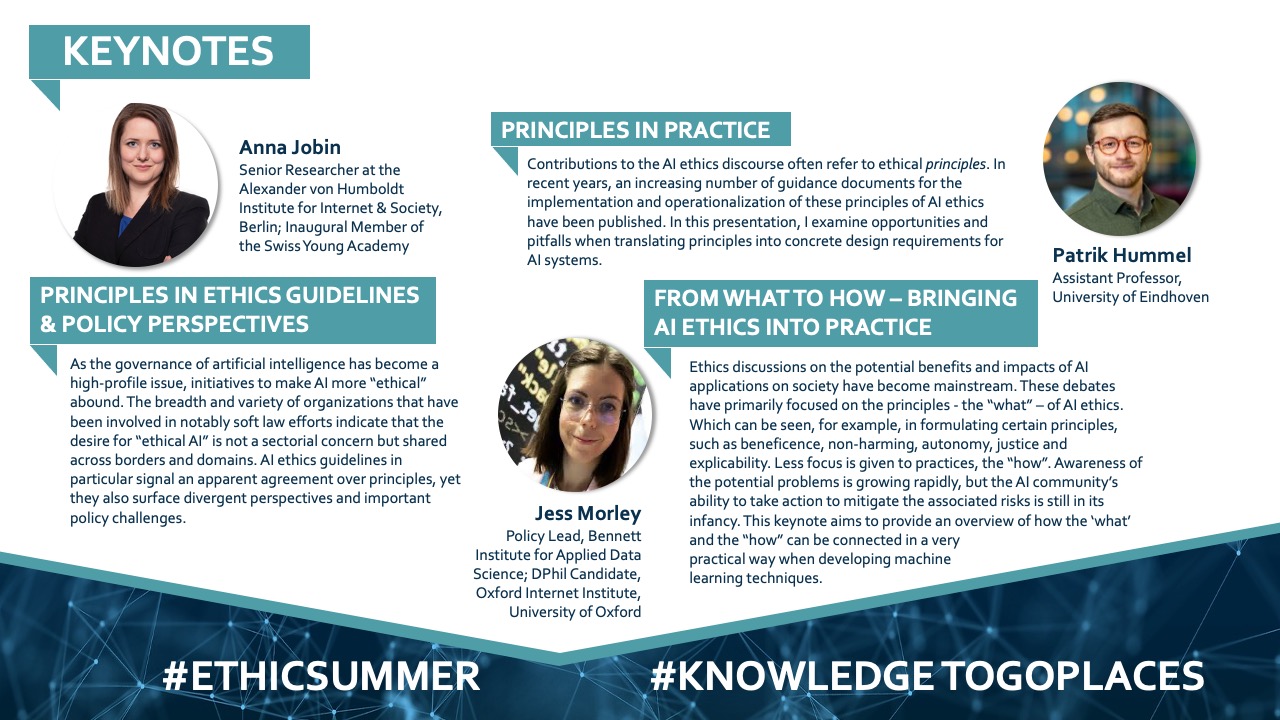

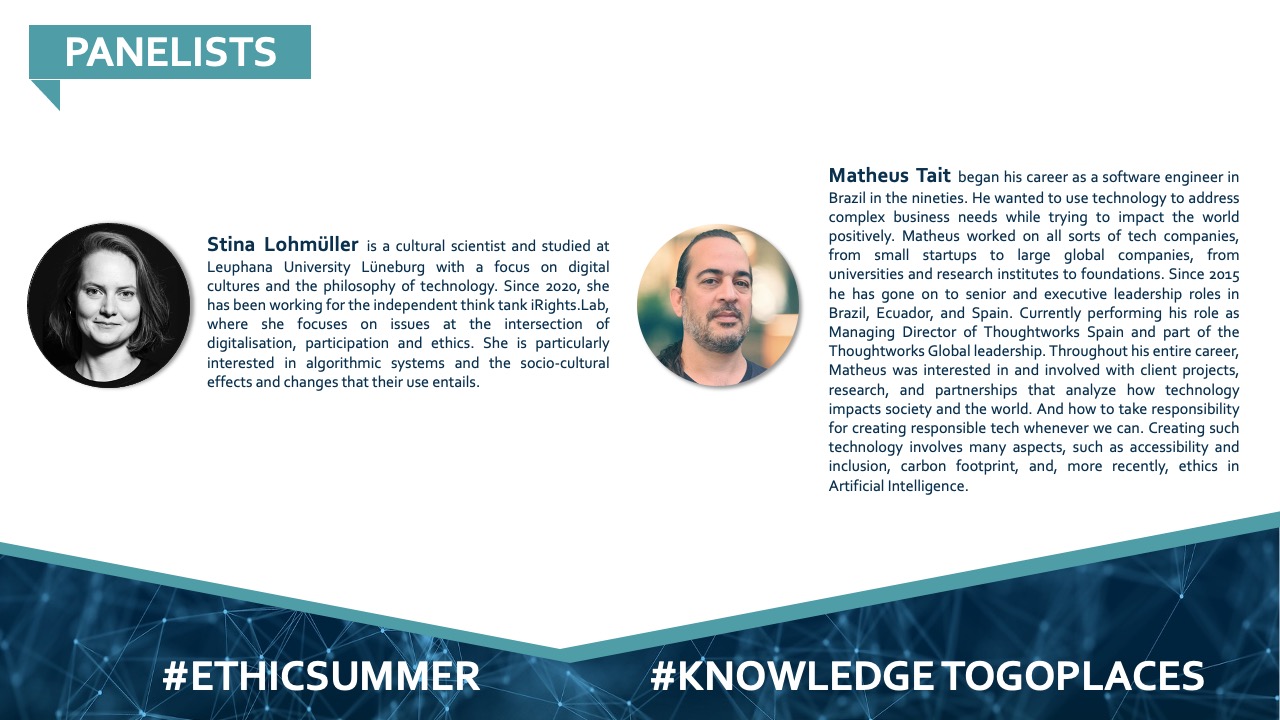

Eben diese Problematiken wurde in den folgenden Tagen in verschiedenen Vorträgen aufgegriffen. Die eingeladenen Vortragenden kamen selbst aus den unterschiedlichsten Fachrichtungen und hatten verschiedene Schwerpunkte im Hinblick auf KI, Ethik und Menschenrechte. So sprachen wir beispielsweise über fehlerhafte KI-Systeme auf staatlicher Ebene, wie sie etwa in den Niederlanden zum Einsatz kamen. Dort wurden Menschen mit doppelter Staatsbürgerschaft automatisch als größere Gefahr für Sozialleistungs- und Steuerbetrug eingestuft als Niederländer mit einfacher Staatsbürgerschaft. Ebenso bekamen wir einen Einblick in die Schwierigkeiten der Umsetzung ethischer Richtlinien beim Einsatz von KI. Da es bisher keine einheitlichen Regelungen gibt, obliegt es den einzelnen Unternehmen und Behörden ihre Richtlinien festzusetzen. Unzureichende Transparenz, der Vorwurf des ethics washing und gewollte Schwammigkeit in der Formulierung dieser Dokumente sind hier nur einige der Probleme. Doch nicht nur die praktische Umsetzung ethischer Ansätze in Verbindung mit KI war Gegenstand der Diskussionen. Ebenso wichtig waren grundlegende Konzepte, wie etwa die Frage der Verantwortung. Wer ist für die Sicherung meiner Daten zuständig? Wer muss die Einhaltung ethischer Richtlinien kontrollieren? Und wie verschiebt sich Verantwortung, sobald ich einmal meine Einwilligung, beispielsweise in Form von Cookie-Nutzung auf einer Website, gegeben habe? Als wäre das nicht schon kompliziert genug, muss man dann auch gleich noch fragen, wie eigentlich moralische Verantwortung hier mit hineinspielt. All diese Fragen und Ansätze zeigen, dass es sich bei dieser Thematik um ein komplexes Gebilde aus theoretischen Überlegungen und praktischer Anwendung bzw. Umsetzung handelt. Um einen genaueren Einblick in die Erkenntnisse und Diskussionen der Summer School zu geben, werden einige dieser Problemstellungen in den Videos auf dieser Seite näher erläutert.

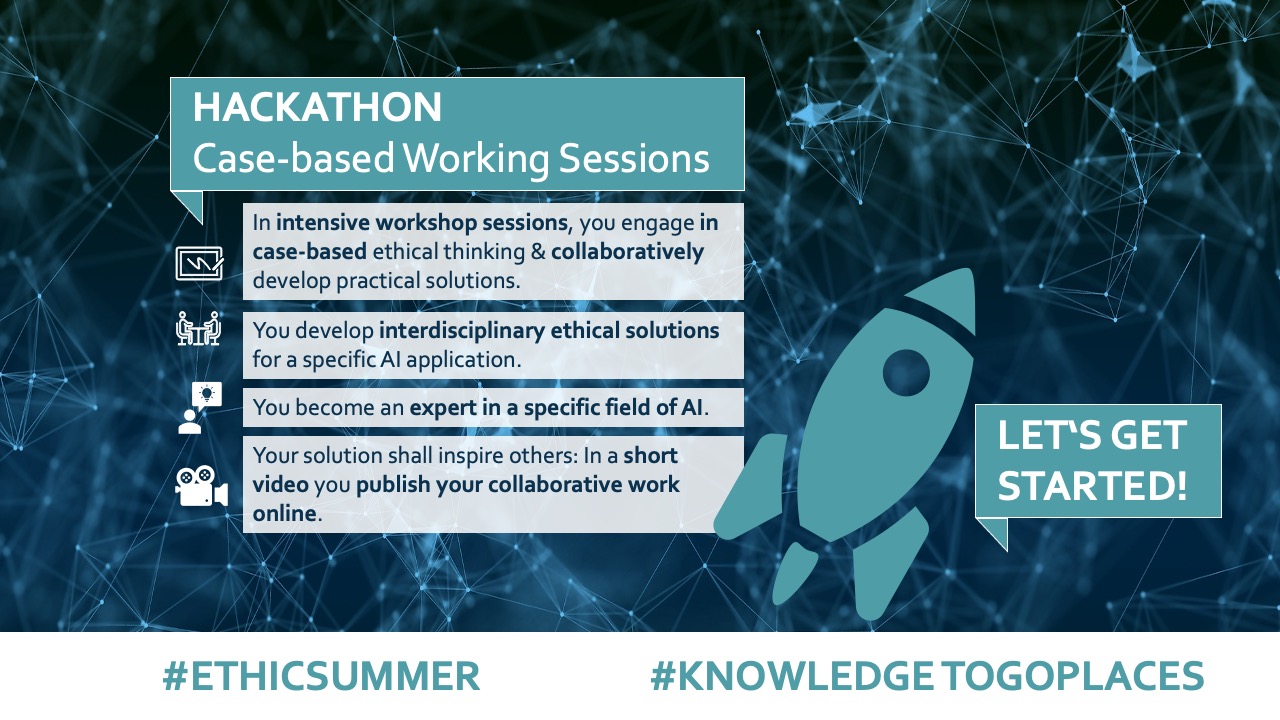

Neben den Vorträgen und dem Input von außen durften wir aber auch selbst aktiv sein. In kleinen Gruppen sollten wir einen Vortrag zur Nutzung einer KI-basierten Technologie erarbeiten. Zur Wahl standen hier verschiedene Schwerpunkte. Während sich eine Gruppe mit dem Einsatz von Predictive Policing durch die Polizei beschäftigte, stellte eine andere die Idee eines Digital Twin vor, eines digitalen Klons zur besseren Verwaltung und Analyse medizinischer Daten. Auch der Einsatz von KI zur Erkennung von Brustkrebs sowie die Nutzung von Algorithmen zur besseren und faireren Verteilung von Sozialleistungen wurden diskutiert. Diese Gruppenarbeit führte uns deutlich vor Augen, wie schwierig es ist, ein Projekt, das KI nutzt, unter Einbezug ethischer und menschenrechtlicher Konzepte und Richtlinien umzusetzen und durchzuführen. Schon die Zusammensetzung der Gruppen war hier herausfordernd, denn wir Studierende kamen alle aus verschiedenen Disziplinen: aus der Ethik, der IT, der Theologie, manche im Master, manche auf Lehramt. Bei so vielen unterschiedlichen Hintergründen war es anfangs oftmals gar nicht so einfach, einen gemeinsamen Startpunkt zu finden, da jeder andere Schwerpunkte setzte und die Bewertung der Vor- und Nachteile unterschiedlich ausfiel. Gleichzeitig ermöglichte diese Mischung aber auch einen intensiven Austausch, der uns allen neue Perspektiven ermöglichte. Diese interdisziplinäre Arbeit kann vielleicht auch ein Teil der Lösung sein, denn am Ende der Summer School waren sich alle einig: Nur gemeinsam kann eine Lösung gefunden werden. KI, Ethik und Menschenrechte müssen eng miteinander zusammenarbeiten, um zukünftig den verantwortungsbewussten Einsatz von KI gewährleisten zu können. Die Summer School war hierfür ein wichtiger Schritt.

Doch die Arbeit war nicht das Einzige, das in dieser Woche im Fokus stand. Auch das Vergnügen durfte nicht fehlen. So nutzten wir unsere freie Zeit, um Madrid kennenzulernen. Neben einer Stadtführung zeigten uns die spanischen Studierenden vor allem auch die kulinarische Seite der Hauptstadt. Das hieß: Tapas, Tapas und noch mehr Tapas. Und so gab es durch diese geselligen Abende neben Patatas Bravas auch einen kulturellen Austausch und neue Freundschaften, die wir mit nach Deutschland nehmen konnten.

Doch die Arbeit war nicht das Einzige, das in dieser Woche im Fokus stand. Auch das Vergnügen durfte nicht fehlen. So nutzten wir unsere freie Zeit, um Madrid kennenzulernen. Neben einer Stadtführung zeigten uns die spanischen Studierenden vor allem auch die kulinarische Seite der Hauptstadt. Das hieß: Tapas, Tapas und noch mehr Tapas. Und so gab es durch diese geselligen Abende neben Patatas Bravas auch einen kulturellen Austausch und neue Freundschaften, die wir mit nach Deutschland nehmen konnten.

Zum Schluss bleibt mir nur, mich ganz herzlich bei meinen Komiliton:innen sowie bei Hannah und Eva für die tolle Organisation, den intensiven Austausch und die schöne Zeit in Madrid zu bedanken.

Von Carima Jekel, FAU-Studentin bei der Summer School

[1] Rich, Elaine: Artificial Intelligence and the Humanities. In: Computers and the Humanities, Apr.-Jun., 1985, Vol. 19 No.: Natural Language Processing, S. 117– 122, <https://www.jstor.org/stable/30204398> [25.07.2022].